DeepFake y la realidad paralela

Entre el escándalo del Pentágono en llamas, la pornografía en que podríamos salir cualquiera de nosotros, los debates en Hollywood pero también la creación artística innovadora y el primer capítulo de Black Mirror 6 tiene lógica preguntarnos ¿podemos confiar en lo que vemos?

El impacto que la tecnología de DeepFake está teniendo a nivel global en nuestra percepción de la realidad moviliza una reflexión sobre cómo cambia la forma en que interactuamos con medios digitales. Se trata de una técnica de inteligencia artificial con la que se crean videos y audios falsos como auténticos. La palabra «deepfake» es una combinación de las palabras «deep learning» y «fake», que hacen referencia al aprendizaje profundo para crear falsificaciones.

El término «DeepFake» se ha vuelto cada vez más conocido en los últimos años, especialmente en relación con su uso en la creación de contenido manipulativo y engañoso. Sin embargo, también hay un potencial positivo para el uso de esta tecnología, como en el arte y en la creación de contenido de entretenimiento.

¿Cómo es la movida?

La tecnología de deepfake utiliza algoritmos de aprendizaje profundo para analizar y sintetizar imágenes, sonidos y texto. Los algoritmos de DeepFake se entrenan para aprender a imitar las características de una persona en particular, como su apariencia, voz y movimiento, y luego se utilizan para crear vídeos que parecen mostrar a esa persona diciendo o haciendo cosas que nunca hizo.

Ese aprendizaje se da a partir de grandes cantidades de datos, y luego pueden generar imágenes y sonidos que parecen auténticos, incluso cuando no lo son. La técnica se ha utilizado para crear videos falsos de políticos, celebridades y otras personas, y ha generado preocupación por su potencial para ser utilizada con fines malintencionados.

Una preocupación, por tanto, es el potencial de Deepfake para ser utilizado en la manipulación de la opinión pública. Los videos falsos pueden ser utilizados para difundir información errónea y engañosa, y pueden ser especialmente efectivos en campañas de desinformación destinadas a influir en las elecciones y otros eventos importantes, así como la divulgación con imágenes de noticias falsas como el inexistente incendio en el Pentágono del pasado mes de mayo.

Otra de las aplicaciones más conocidas y preocupantes de Deepfake es la creación de videos pornográficos falsos que parecen mostrar a una persona real. Estos videos, conocidos como «deepfake porn», pueden ser utilizados para el acoso y la extorsión, y son especialmente preocupantes porque pueden ser difíciles de detectar.

Lo de los deepfakes y el porno no es algo nuevo. El problema viene de unos cuantos años atrás y algunas celebrities, como Scarlet Johansson, Emma Watson o Gal Gadot llevan ya tiempo lidiando con él. Tanto, que la intérprete de Black Widow ha llegado a dar por «causa perdida» en una reflexión para Washington Post.

Las imágenes creadas con inteligencia artificial se pueden utilizar para crear arte, probarse ropa en probadores virtuales o ayudar a diseñar campañas publicitarias. Pero los expertos temen que el lado más oscuro de estas herramientas de fácil acceso pueda empeorar algo que daña principalmente a las mujeres: la pornografía deepfake no consensuada, como se señaló recientemente también el portal CubaSí.

¿Es un tema aislado para Cuba?

Este es un tema más cercano de lo que crees. Por una parte, la globalización ha hecho que Cuba forme parte de las corrientes de debate del mundo tecnológico mucho más a menudo con la expansión del acceso a Internet. Por otra, desde el arte hasta lo que podría parecer juego de niños —pero no lo es tanto— acercan nuestra realidad a la manipulada con DeepFake.

Incluso, en la página fakeyou.com desde hace diez meses aproximadamente se podía encontrar un bot creado al introducir varios discursos del presidente Miguel Díaz-Canel Bermúdez, desarrollando un sintetizador de voz con DeepFake que generaba audios que emulaban su voz con cualquier texto que se le introducía.

https://cdn.iframe.ly/api/iframe?url=https%3A%2F%2Fwww.cubahora.cu%2Fciencia-y-tecnologia%2Fblack-mirror-retrato-de-un-futuroquestion-perturbador&key=c19d95c7e440050a3d5463906745efac&v=1&app=1

Resulta alarmante puesto que los usuarios que no estén al tanto de la existencia de esta posibilidad de creación falsa pueden creer todo lo que oyen sin siquiera ponerlo en duda. De forma tal que es una tecnología bastante usada para la divulgación de noticias falsas. Como también puede implicar una tendencia a la sexualización infantil cuando se usan aplicaciones como juegos con esta tecnología.

El contenido generado por DeepFake puede ser inapropiado para menores de edad, ya que puede contener imágenes o palabras que no son adecuadas para su edad. Si un niño o niña desea utilizar una aplicación que utiliza DeepFake para jugar, es importante que los padres o tutores supervisen su uso y se aseguren de que el contenido sea apropiado para su edad.

También vale que los padres o tutores se informen y hablen con los niños y niñas sobre los riesgos asociados con el uso de estas aplicaciones y les enseñen a identificar el contenido engañoso o manipulativo. Asimismo deben conversar sobre aquellas situaciones de uso de su imagen que puede no ser apto para la infancia como los filtros que ponen un rostro con otro cuerpo en un vídeo que por lo general parece bien real.

A pesar de los riesgos mencionados, también hay aplicaciones legítimas de Deepfake. Por ejemplo, se puede utilizar para crear efectos especiales en la industria del cine y la televisión, y también se puede utilizar para mejorar la calidad de la traducción de voz y la sincronización de labios en la postproducción, así como en obras de artes visuales y nuevos medios.

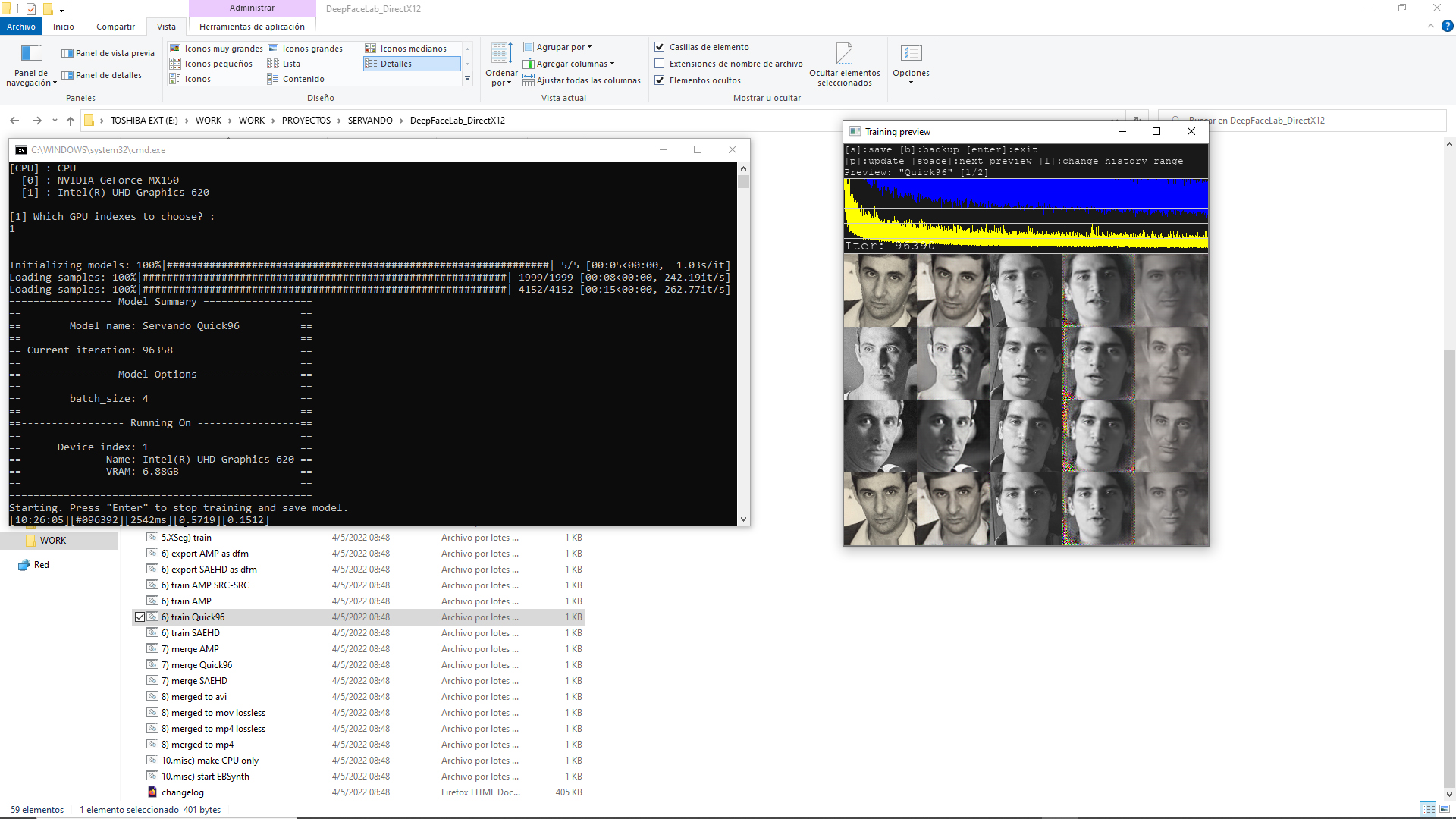

En cuanto al arte y el DeepFake, se ha explorado el uso del DeepFake como una herramienta artística en sí misma. Algunos artistas han utilizado esta técnica para crear obras de arte que desafían la realidad y cuestionan la autenticidad de lo que vemos en los medios digitales. La Universidad de las Artes (ISA) ha sido sede de talleres

Actualmente, en Cuba desde el Salón Blanco del Convento de San Francisco de Asís se puede ver en la exposición Paisaje para el próximo siglo, dedicada al centenario de Servando Cabrera por parte del Fondo de Arte Joven, una obra del artista Enrique Briño que hace uso precisamente del DeepFake y otras técnicas para recrear la que sería una entrevista en la actualidad con Servando. Sobre todo resulta una motivación para que más artistas perfeccionen la técnica en la búsqueda de nuevas maneras de creación.

Un debate desde la ficción

En otras latitudes el artista Trevor Paglen explora la forma en la que los sistemas de inteligencia artificial son entrenados a ‘ver’ y a ‘percibir’ el mundo al crear una serie de retratos con DeepFake de personas que no existen. Así el también geógrafo americano señala cómo se desencadenan posturas tendenciosas, a partir de sesgos raciales y de género que arrastran las IA con base en los sistemas culturales sobre los que se desarrollan en primer lugar.

En suma, el DeepFake puede ser utilizado como una herramienta artística para explorar temas como la identidad, la autenticidad y la realidad en la era digital. No obstante, también existe un amplio debate sobre cuáles son los límites de su uso en la industria del entretenimiento.

Precisamente, el primer capítulo de la sexta temporada de Black Mirror se hace dicho cuestionamiento que tanto conecta con los límites de la privacidad. En este, Joan, una mujer común, ve cómo una plataforma de transmisión similar a Netflix se apropia de su vida y la convierte en un programa de televisión protagonizado por la imagen de Salma Hayek generada por IA. En el episodio, Joan se une a la verdadera Salma Hayek para destruir la computadora que lo genera y rompen un círculo en el que ninguna tenía control sobre su imagen manipulada.